[RedHat][vLLM]

人工智能的主要算力都是用在推理(Inference)方面,如何降低推理成本和提高推理效率,一直是業界最關心AI問題。

vLLM(Virtual Large Language Model)是加大柏克萊分校 2023 年開發LLM大語言模型推理框架並開源, 提供高輸送量的LLM推理並大大降低GPU記憶用量,迅速成為最受關注的開源項目。 Continue reading “Red Hat推出推理服務器 vLLM普及AI成本下降”

[RedHat][vLLM]

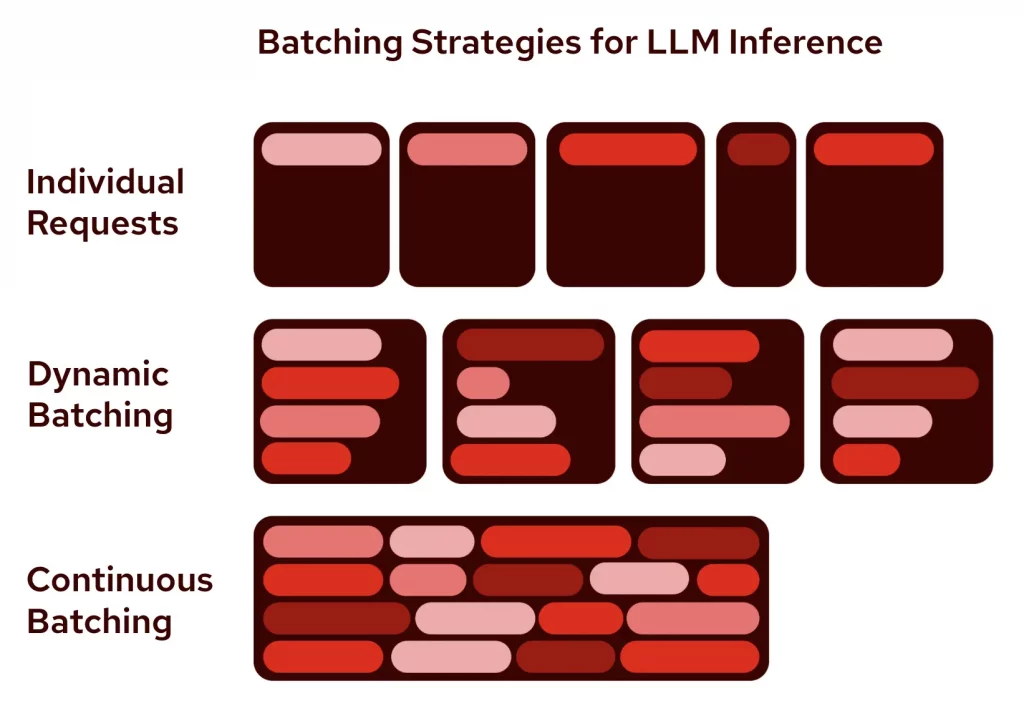

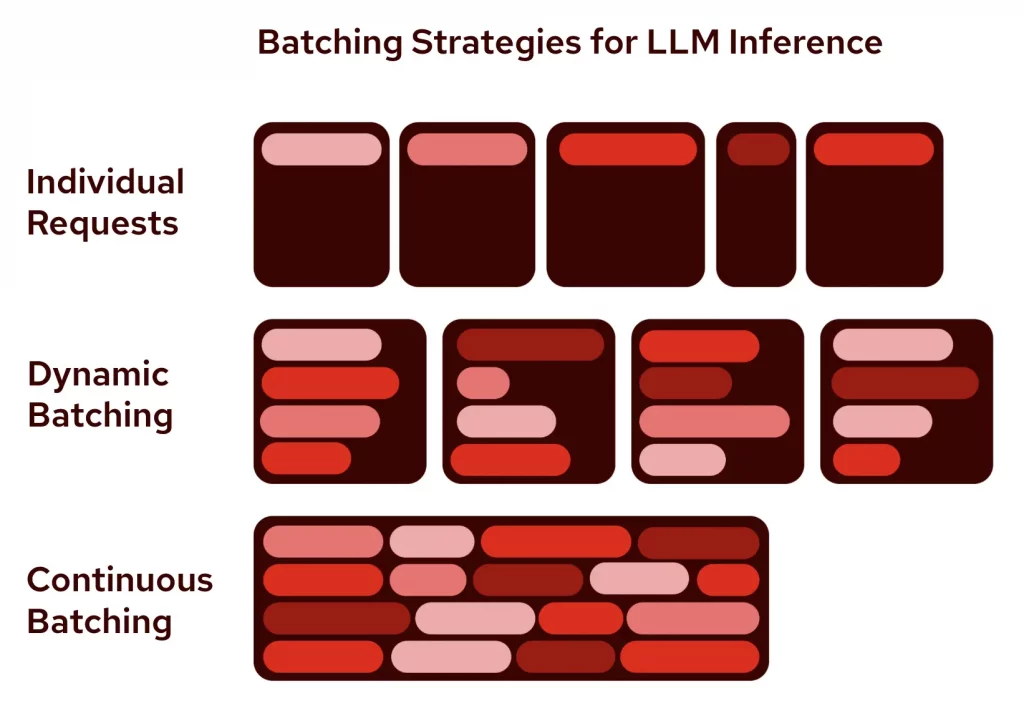

人工智能的主要算力都是用在推理(Inference)方面,如何降低推理成本和提高推理效率,一直是業界最關心AI問題。

vLLM(Virtual Large Language Model)是加大柏克萊分校 2023 年開發LLM大語言模型推理框架並開源, 提供高輸送量的LLM推理並大大降低GPU記憶用量,迅速成為最受關注的開源項目。 Continue reading “Red Hat推出推理服務器 vLLM普及AI成本下降”

企業轉型

新冠疫情之下,除了不少人在家工作,另外就是對於數碼人才的需求急升,不少企業必須數碼轉型,將IT基建虛擬化,以自動化取代人手的工作。 Continue reading “疫情下技術人手短缺 自動化成大勢所趨”

隨著5G推出,很少人會想到跟虛擬化有何關係。事實上,5G並非4G,架構和網絡設計上更完全不同。 Continue reading “虛疑化網絡迎5G大時代”